Alla fine di febbraio 2026, Pete Hegseth, Segretario alla Difesa dell'amministrazione Trump, ha consegnato ad Anthropic un ultimatum: accettare la formula «any lawful use» per i modelli Claude — ovvero nessuna restrizione su sorveglianza di massa e sistemi d'arma autonomi — oppure essere classificata come «rischio per la supply chain», la stessa categoria riservata a Huawei. Dario Amodei ha detto no. Il giorno della designazione, il 28 febbraio, Claude è diventata l'app più scaricata negli Stati Uniti, sorpassando ChatGPT. La settimana dopo, Bloomberg ha riportato ricavi annualizzati per 19 miliardi di dollari.

La storia è, in apparenza, semplice: una guerra tra un'azienda con principi e un'amministrazione senza. Ma come scriveva l'Economist già nel 2020 a proposito della globalizzazione — e come mi sono trovato a osservare, con una certa imbarazzata onestà, in un pezzo sul mio Medium The Abstract — le svolte epocali tendono a sembrar lineari solo quando le si guarda col senno di poi. Il problema è capire, nel momento in cui accadono, quale delle molte traiettorie possibili si stia effettivamente materializzando.

Perché importa

Il motivo per cui la crisi Anthropic-Pentagono non è una notizia di tecnologia ma una notizia di politica è sintetizzato con precisione da Gregory Allen di CSIS in una lunga conversazione con Ben Thompson su Stratechery: il governo americano, nel settore dell'AI, non è il cliente gigantesco che crede di essere. Nel mondo dei carri armati, sì. Nel mondo dei modelli linguistici, è marginale. Questo rovesciamento dei rapporti di forza — le aziende hanno i carrots, il governo ha gli stick, e nessuno dei due ha capito quanto siano piccoli i carrots dell'altro — è la struttura profonda della crisi, non il carattere di Hegseth.

A questo si aggiunge la lettura di Andrew Sharp su SharpText: la trappola retorica in cui si è cacciato Amodei è stata costruita da Amodei stesso. Se l'AI è tecnologia capace di «sovrastare l'umanità» e di fornire istruzioni per costruire armi biologiche, allora un governo democratico (ma anche non democratico) non può semplicemente accettare che un'azienda privata ne detenga il controllo normativo. L'argomento per i guardrail è esattamente l'argomento per la nazionalizzazione gestionale. Elegante, nel modo in cui sono eleganti le trappole ben costruite.

L'idea, da un mix di curiosità e pigrizia

A quel punto mi è venuto in mente di fare quello che avrei dovuto fare già nel 2020, quando invece ho pubblicato un articolo sulla fine della globalizzazione senza scenari — e ho citato Pierre Wack quasi come autodifesa preventiva. Allora scrivevo da solo; adesso ho un abbonamento a Claude abbondantemente sfruttato. In entrambi casi, il tempo e le energie a disposizione erano pochisisme. Ma questa volta ho potuto decidere di fare gli scenari davvero.

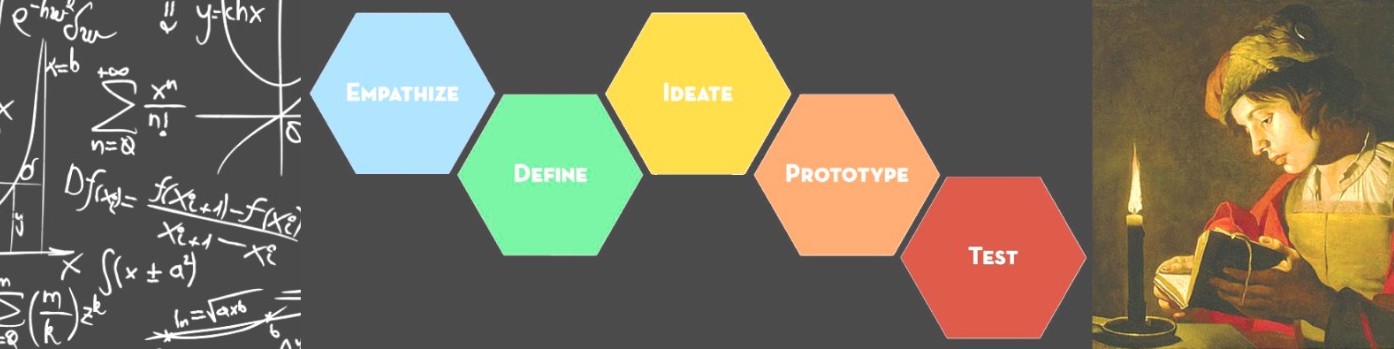

La metodologia di Shell, teorizzata da Wack nel 1985 su Harvard Business Review e sistematizzata da Cornelius, Van de Putte e Romani nel 2005 sulla California Management Review, è una delle poche metodologie di management che ha effettivamente superato il test dell'utilità empirica: Shell fu l'unica major a non essere colta di sorpresa dallo shock petrolifero del 1973 perché aveva costruito scenari che lo contemplavano. Il metodo non prevede previsioni: costruisce narrazioni strutturalmente plausibili attorno agli assi di incertezza genuina, per cambiare il modello mentale del lettore più che per indicargli cosa farà il futuro.

Ho appurato che Claude conosce bene questa letteratura. Mi ha anche avvertito che funziona meglio con asset e commodities come i combustibili fossili, i cui cambiamenti di scenario sono più lenti che per la tecnologia AI nel 2026. Bravo, Claude: tutto giusto. Ma ho cominciato ugualmente.

Il processo

La prima elaborazione è avvenuta su Gemini, con una reverse interaction: anziché chiedere al modello di costruire scenari, gli ho chiesto di smontare le mie ipotesi iniziali con domande socratiche. È una tecnica che uso per rompere il confirmation bias della fase generativa — faccio fare al modello il lavoro del contraddittore, non del co-autore. Ne è risultato un lavoro sintetico, fedele alle premesse e non troppo avvincente da leggere.

Il materiale grezzo è poi passato a Claude, dove ho replicato la stessa procedura: prima le domande, poi la revisione profonda. Ho chiesto esplicitamente a Claude di usare i criteri metodologici di Wack — assi di incertezza genuina vs. elementi predeterminati, real options, frame esplorativi non normativi — e di segnalare ogni volta che stava scambiando una previsione per uno scenario. Il risultato è stato un primo draft in cui la Cina era praticamente assente: trattata come sfondo geopolitico, non come variabile strutturale. Me ne sono accorto io, e il difetto nasceva ovviamente dalla mia impostazione. Cos'altro, se no?

A quel punto ho reintrodotto la Cina attraverso una seconda reverse interaction, focalizzata specificamente sul ruolo di TSMC come deterrente strategico nell'era Xi, sulla dipendenza da NVIDIA come rischio di settore asimmetrico, e sulla dialettica Power/Wealth di Gilpin come framework interpretativo. Il report si è espanso in otto scenari — quattro principali e quattro varianti «b», attivate dallo shock Taiwan-TSMC — con un asse orizzontale ridefinito come problema di sostenibilità dei ricavi dell'intero settore AI, non solo di Anthropic.

Gli ultimi due interventi rilevanti sono stati due articoli: la già citata intervista di Thompson ad Allen su Stratechery (5 marzo) e il pezzo di Sharp su SharpText (6 marzo). Il primo ha aggiunto la genealogia del contratto con il Pentagono attraverso Jack Clark e il modello Starlink come terza via contrattuale. Il secondo ha introdotto la prospettiva storico-legale — AT&T/NSA, Montgomery Ward/FDR, Youngstown/Truman — e la funzione epistemica dell'anti-catastrofismo: i momenti di crisi acuta tendono a far sopravvalutare sistematicamente gli scenari peggiori. Ho lasciato la tensione tra le due letture irrisolta nel documento, come quinta chiave di lettura trasversale.

Ho poi fatto organizzare la bibliografia, che nel frattempo è esplosa, in sezioni tematica. Il report finale è di circa una ventina di pagine. Amo i testi lunghi, se non si nota. L'ho pensata in italiano e poi l'ho fatta tradurre in inglese.

Il bilancio — e una domanda aperta

Anthropic ha pubblicato nei giorni scorsi un report sull'impatto dell'AI sul mercato del lavoro. (Viene da chiedersi: l'avrà fatto con Claude?) La conclusione è che i lavoratori con più istruzione, in settori cognitivi ad alto valore, sono quelli che possono essere più esposti alla sostituzione. Dico "possono", perché da un lato è abbastanza chiaro un effetto di potenziale jobless growth, come dicono quelli bravi. Ma d'altra parte l'AI in questi ambiti sembra una gigantesca libreria che conosce molto della letteratura professionali di alcuni campi — «Claude, conosci lo scenario planning?» — ma non è affatto detto che lo sappia mettere in pratica.

Non è una sorpresa: è esattamente quello che la teoria del capitale umano avrebbe predetto se avesse preso sul serio la distinzione tra compiti routinari e non routinari di Autor, Levy e Murnane — che è del 2003, per chi contasse sulle scienze sociali come scudo.

La domanda che mi pongo alla fine di questo esercizio è quindi diversa da quella che mi aspettavo di pormi. Non è «questo lavoro avrebbe potuto farlo un modello da solo?» — la risposta è probabilmente sì, con un prompt sufficientemente strutturato. La domanda è: questo lavoro è migliore perché l'ho fatto con un modello?

E la risposta, in questo caso specifico, è sì — ma per una ragione che non riguarda la potenza di calcolo. In primo luogo, perché se l'avessi fatto senza strumenti non avrei formulato nemmeno una teoria, ma mi sarei limitato alla fiction come nel mio pezzo del 2020. Inoltre, anche se anche in questo caso non abbiamo una ricerca vera, pubblicabile, la reverse interaction mi ha costretto a esplicitare le assunzioni che normalmente lascio implicite. Il modello non ha avuto intuizioni che io non avevo: ha avuto la pazienza di farmi dire ad alta voce quello che sapevo già (e che è magari tutto sbagliato). Questo, in fondo, è quello che fanno i buoni metodi di management da sempre — Wack compreso. Sta poi a me, o al centro di ricerca, fare la ricerca che non ho fatto.

Il che mi porta alla domanda aperta: alla luce di tutto questo, le scienze del management sono finite? O è esattamente adesso, quando un modello può fare il lavoro di scaffolding metodologico che prima richiedeva un consulente costoso, che potrebbero finalmente diventare scienze sociali vere — con campioni grandi, repliche, e la possibilità di testare le assunzioni invece di venderle? Io credo che darsi alla ricerca in molti campi, oggi, possa essere sia entusiasmante, sia terrificante. E comunque sempre meglio farsi un hobby potenzialmente monetizzabile e non erodibile dalla vostra AI preferita. Taijiquan, massoterapia... C'è molta scelta.

I report sono disponibili nella sezione Learning Log di questo sito.